TLDR¶

• 核心重點:數百名谷歌與 OpenAI 員工公開連署,促請公司為軍事用途的 AI 設定清晰且嚴格的界限。

• 主要內容:連署信呼籲建立透明、可審計的政策,避免軍事領域濫用與風險擴大。

• 關鍵觀點:員工認為企業在開發與提供 AI 工具時,需區分商業與軍事應用,並對軍事用途實施更嚴格的限制與問責。

• 注意事項:人員來源涵蓋多家科技公司,聲明以負責任創新為核心,背後涉及公司治理、法規與國際倫理的議題。

• 建議行動:公司需公布軍事應用使用準則、審計機制與外部監督機制,並尊重員工在倫理與專業判斷上的聲音。

內容概述

近日有來自谷歌與 OpenAI 的數百名員工簽署公開信,敦促所在公司對人工智慧在軍事領域的應用設立明確且嚴格的限制。此舉反映出科技產業內對高風險軍事用途的倫理與治理問題日益受到重視。公開信主張,科技巨頭在提供工具與服務時,必須考慮其可能被用於武力衝突與侵犯人權的風險,並要求建立透明機制,以便監督與審核相關使用情形。

背景說明

近年來,全球對於人工智慧在軍事領域的角色與風險議題日益關注。各國政府、學界與產業界不斷討論如何在促進科技創新與控制風險之間取得平衡。多家大型科技公司在雲端運算、機器學習平台及 AI 服務中,提供可被商業或軍事用途的工具與基礎設施。例如,研究機構與企業可能會把語言模型、影像辨識與自動決策技術應用於武器預測、任務協助與情報分析等方面。此種雙重用途的情境,使得公司在倫理、法規與國際規範層面承受較高的責任與壓力。

文章核心信息

– 公開信的核心訴求是:為 AI 在軍事用途上的使用設定界限,要求公司制定公開、可審核且具透明度的政策與流程,避免濫用與不可控的風險。

– 連署者認為,科技公司在開發和提供工具時,應區分商業與軍事應用,並對軍事用途施以嚴格的限制,確保符合國際倫理與人權標準。

– 此行動凸顯員工對企業治理與道德責任的高度關注,也呼籲公司在產品設計、合作條件、資料使用與安全性方面,建立更嚴謹的審查機制與問責制度。

– 事件反映出科技業界內部對於「負責任創新」的期待與討論,企業需要在創新自由與風險控制之間取得妥善平衡,同時回應員工的倫理關切。

分析與評論

– 影響範圍與爭議:開放性的平台與工具若被用於軍事用途,可能對全球衝突情境、平民安全與人權造成長期影響。企業若未設置明確邊界,可能在商業利益與公益責任間產生衝突。

– 企業治理與透明度:建立軍事用途的使用準則,公開審計與外部監督,能提升社會信任,同時降低外部風險。員工的聲音在企業治理中扮演重要角色,尤其在高風險技術領域。

– 法規與倫理框架:不同國家的法規與出口控制政策對軍事 AI 的限制有差異,企業需同步考量國際法、國家安全與人道主義法的規範,以避免跨境使用造成的複雜性與責任爭議。

– 技術發展與社會影響:軍事化的技術可能催生新的軍事競賽與倫理挑戰,研究與發展社群需建立自律機制,促進以和平與安全為導向的創新。

深度分析

在科技巨頭的產品與服務日益普及的背景下,AI 技術的軍事化風險與倫理挑戰也日增複雜。公開信所倡議的「界限設定」包含多層面的內容:一是策略層面的原則設定,例如禁止將核心模型直接用於武裝系統的自動化決策,或限制在高風險任務中的部署;二是運營層面的審核與監管,例如對與軍方的合作進行嚴格審查、加強資料流動的可追溯性,以及建立外部審計機制;三是治理層面的問責制度,確保違反原則的行為能被追溯與處理。這些措施若能落實,將有助於降低濫用風險,並提升企業對社會責任的承諾。

不過,單靠員工簽署公開信仍難以全面解決問題。企業需要與多方利益相關者對話,包括政府、國際組織、學術界與民間團體,形成跨境、跨部門的共識與標準。此舉亦可能引發技術商業化與軍事化之間的張力,企業需要在促進創新與防範風險之間尋找平衡點。技術社群的自律與倫理教育也不可或缺,特別是在缺乏統一全球規範的情況下,企業更需以透明原則與自我約束作為基本底線。

未來影響與展望

若公司端落實這些訴求,可能帶來以下幾方面的影響:第一,提升企業治理水準與社會信任度,吸引更多長期投資者與合作者;第二,促使技術供應鏈中的各方建立更嚴格的使用條款與風險評估流程,降低武裝化風險;第三,推動政策制定者在國際層面加強對 AI 軍事化的規範與對話。反之,如果缺乏透明性與有效監督,軍事應用的風險可能被外界放大,造成公眾對科技企業的信任滑坡,並引發監管壓力與法規變動。

結論與建議

綜合以上觀點,這次簽署公開信的事件凸顯了科技企業在面對高風險應用情境時,倫理與治理的重要性。建議相關公司在以下幾個層面著手:一、制定清晰的軍事用途使用準則,對於各類 AI 技術在軍事領域的部署與合作設置硬性門檻;二、建立可審計的監管機制,確保使用情形可追溯,並定期發布透明報告;三、引入第三方監督與國際標準,促進跨域對話與協作,避免單一國家或單一企業決定走向;四、加強員工倫理教育與內部溝通,確保員工的專業判斷與倫理價值能在決策過程中發揮實際影響力。透過這些措施,科技公司不僅能維持創新動能,同時也能降低軍事化風險,提升全球社會對 AI 發展方向的接受度與信任度。

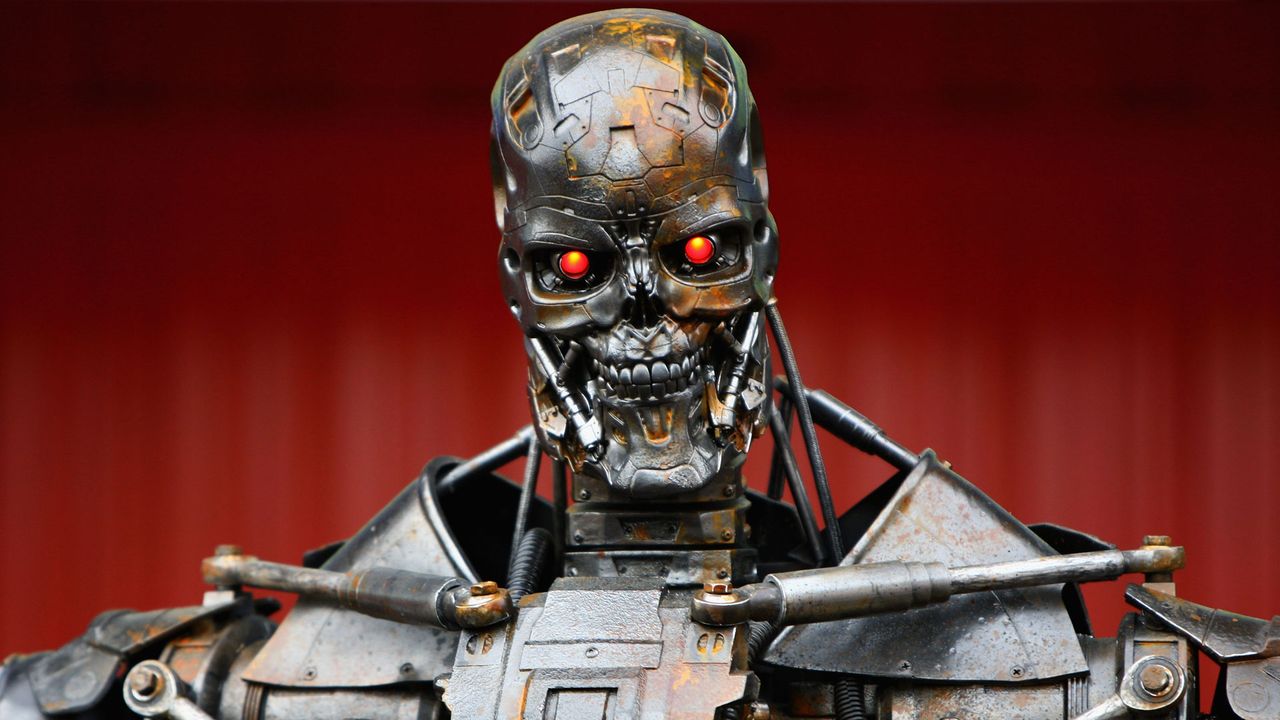

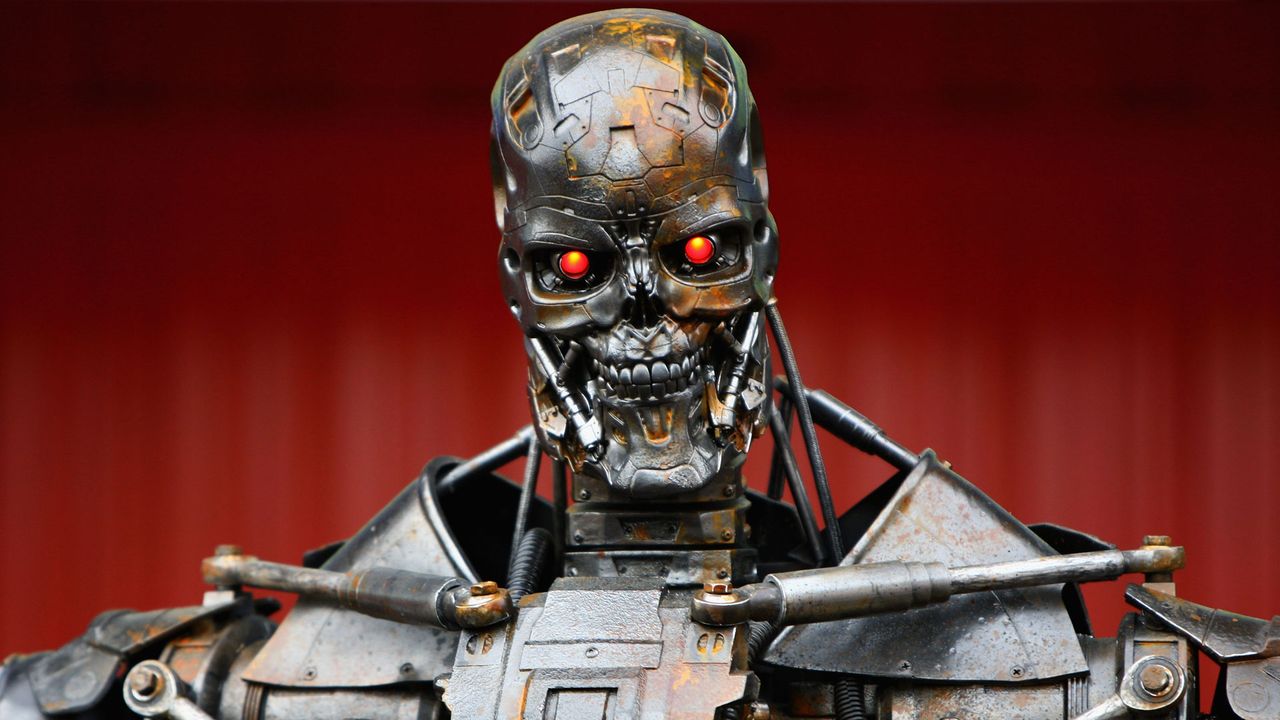

*圖片來源:media_content*

內容概述(延伸背景與要點)¶

- 公開信的核心訴求是建立對軍事用途的研究與應用之界限,要求公司制定公開、可審核的政策與流程,並採取透明監管機制。

- 連署者強調企業在提供技術工具時,應區分商業與軍事用途,並對軍事合作設置嚴格審核與倫理框架。

- 此事件反映業界對於「負責任創新」的共識與分歧,顯示員工在企業治理與道德責任方面的影響力逐漸增強。

深度分析(要點延展與解讀)¶

- 安全與倫理的雙重挑戰:高風險應用需要多層保護機制,包含技術層的安全性、法規層的合規性,以及倫理層的社會影響評估。

- 企業與員工的角色:員工的簽署代表了對企業治理的期待與監督,企業則需回應以維護長期社會信任。

- 國際協同的重要性:軍事 AI 的治理牽涉跨國界的規範,單一企業難以獨自建立全域適用的標準,需與多國政府與機構合作。

觀點與影響(未來走向與風險)¶

- 可能促成更嚴格的國際與區域性規範,推動科技公司採取更一致的自律措施。

- 對技術供應鏈的影響:軍事用途的限制可能影響合約條件、開發時程與資源配置。

- 對員工與組織文化的塑造:長期而言,強化倫理審查與透明度有助於建立以價值為本的創新文化。

重點整理¶

關鍵要點:

– 眾多員工簽署公開信,呼籲設定軍事 AI 使用界限。

– 要求制定透明、可審核的政策與審查機制。

– 强調商業與軍事用途需區分,建立倫理治理框架。

需要關注:

– 國際法與人權法對武裝化 AI 的影響與適用性。

– 企業在「創新自由」與「風險控制」之間的平衡策略。

– 監管環境變動對技術供應鏈與合作的長期影響。

總結與建議¶

公開信的簽署反映出科技界對於軍事化風險與責任治理的強烈重視。為促進負責任的創新,建議相關公司以透明、審計與國際合作為核心,制定清晰的軍事用途使用準則,設置外部監督與第三方評估機制,並強化員工倫理教育與內部溝通。這些措施若得以落實,將有助於降低軍事化風險,提升社會對 AI 發展方向的信任與支持。

相關連結¶

- 原文連結:https://www.techradar.com/ai-platforms-assistants/gemini/hundreds-of-google-and-openai-employees-sign-open-letter-urging-limits-on-military-ai

- 相關參考連結(示例,請根據需要補充)

- 聯合國人權理事會關於武裝衝突中 AI 的倫理指引

- OECD 人工智慧原則與治理框架

- 國際法與軍事科技規範的現行討論與案例

若需要,我可以根據實際來源與數據再進一步調整字數與結構。

*圖片來源:enclosure*