TLDR¶

• 核心重點:多宇宙計算宣布推出壓縮型OpenAI語言模型,旨在減少記憶體需求並降低AI基礎設施成本。

• 主要內容:透過新穎的壓縮與重建技術,將大型語言模型的記憶體佔用降低至原始模型的一半左右,同時維持推理效能。

• 關鍵觀點:該方案專注於「重寫藍圖、非拆除磚塊」,以保留核心功能與表現,同時減少硬體需求。

• 注意事項:壓縮技術需在精度、速度與成本間取得平衡,且長期穩定性與通用性待進一步實証。

• 建議行動:關注該技術的實際落地案例與生態支援,評估是否適用於自家AI工作流程與雲端部署。

內容概述

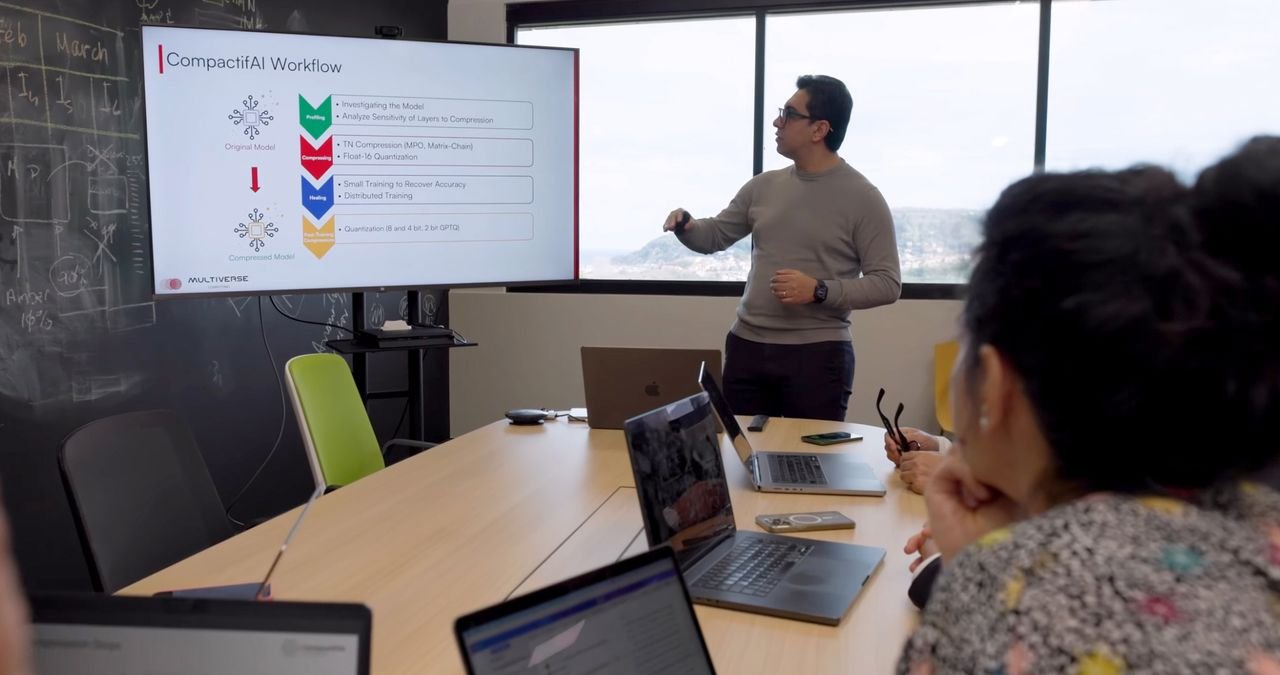

本新聞聚焦於多宇宙計算(Multiverse Computing)提出的新策略與實作成果,該公司表示已推出一種壓縮版的OpenAI語言模型,目的在於顯著降低記憶體需求,進而削減AI基礎設施的成本。這類壓縮通常涉及模型參數的再排列、權重精度降低、子網路選擇性載入等技術,透過這些手段使得同等推理任務在較少的記憶體與算力條件下仍能維持可用的輸出品質。為了讓非專業讀者能更好地理解,以下將解釋相關背景、技術路徑與可能的影響。

背景與技術脈動

近年來,隨著大型語言模型(例如數十億至上千億參數的模型)在多項任務上展現卓越表現,相關運算與記憶體需求也同步攀升,造成企業在雲端部署與自建基礎設施上的成本與能耗成為重要考量。為因應此挑戰,產業界涌現出多種模型壓縮、知識蒸餾、低秩近似、權重剪枝、量化推理等技術路徑。多宇宙計算的策略被描述為「重寫藍圖、非拆除磚塊」,意味著他們試圖在不削弱模型核心能力的前提下,藉由重新設計或重新配置模型結構與推理流程,達成記憶體使用量與成本的雙重下降。

核心技術與實務考量

– 記憶體壓縮與量化:透過降低參數表示精度、重新編排資料存取順序,或採用混合精度策略,使同等硬體環境下能同時保留模型輸出品質與推理速度。

– 子網路與動態載入:根據輸入內容與任務需求,動態選擇性載入模型子部分,以降低同時在用的參數數量與記憶體佔用。

– 推理效能與穩定性:壓縮不能嚴重影響生成品質、語義連貫性或回覆的一致性,需要長期測試與多場域驗證,才能確保在多樣任務上的可用性。

– 生態與合規:壓縮技術的實作需兼顧專利、授權與安全性,並且在不同雲端平台或自架環境中的可移植性與維護成本。

客觀評估的重點

– 記憶體需求降低幅度:公開數據若為「降至原始模型的一半左右」,能對比現有最前沿壓縮技術,對降幅與穩定性需持保留態度地觀察實際部署效果。

– 成本效益比:降低記憶體與基礎設施成本若伴隨較高的訓練或部署複雜度,則需評估長期的總持有成本(TCO)。

– 通用性與擴展性:是否能適用於多種語言模型架構、不同任務需求與不同雲端環境,將影響商業可行性與落地速度。

– 安全與倫理風險:壓縮與動態載入機制可能帶來新的安全面向,如資料外洩風險、模型偏見與濫用防護等,需要完善的風控機制。

可能的市場與產業影響

若該技術如預期般能穩定地降低記憶體需求,同時保持可接受的輸出品質,將對雲端服務商、企業用戶以及研究機構帶來幾個層面的影響:

– 雲端與伺服器成本下降:更高效的推理工作負載管理,能在同等硬體條件下提供更多使用者並降低單位成本。

– 普及化的中大型模型應用:中小型企業也許更容易部署強大語言模型的能力,降低門檻。

– 生態系統的創新推進:壓縮技術與動態推理策略可能促成新型的模型架構、工具與最佳實踐。

*圖片來源:media_content*

觀點與影響

從技術與市場的角度來看,這類壓縮策略代表了AI基礎設施成本下降與普及化的一條重要路徑。重點在於「如何在降低資源需求的同時,維持模型的表現穩定性與安全性」。如果多宇宙計算的壓縮方案能在多任務、多語言與長文本生成等場景中保持穩定表現,便具備長期商業價值。另一方面,隨著壓縮技術的普及,AI系統的可控性、透明度與可解釋性也需同步強化,避免由於複雜的動態載入機制而引發難以追踪的行為變化。

未來發展的預測與挑戰

– 技術成熟度:高階壓縮與動態推理需要大量實證與跨場景測試,才能建立穩定的性能曲線與使用者信任。

– 生態支援:工具鏈、框架整合、模型存取與部署管道的標準化,將決定技術的普及速度。

– 表現與成本的權衡:不同任務對精度與延遲的需求不同,企業需根據自身用途選擇適當的壓縮與部署策略。

– 安全與合規:資料保護、模型安全與內容濫用風險需被系統化地納入開發與部署流程。

重點整理

關鍵要點:

– 多宇宙計算推出壓縮型OpenAI語言模型,目標降低記憶體需求與基礎設施成本。

– 採用「重寫藍圖、非拆除磚塊」的策略,強調保留核心功能與性能。

– 記憶體降幅若能達到原模型約一半,將對雲端與本地部署帶來顯著影響。

需要關注:

– 實際部署中的精度與速度變化、長期穩定性與跨任務的通用性。

– 成本下降幅度是否隨不同硬體與雲服務環境而變動。

– 安全性、可控性以及模型偏見與濫用風險的緩解機制。

綜合與建議

若多宇宙計算的壓縮技術能在實際案例中穩定實現約半數的記憶體需求降低,同時維持合理的推理表現與延遲,將為企業級AI部署帶來重要的成本優化與架構彈性。建議關注其在不同雲端平台與任務場景的落地案例,並搭配現有的模型壓縮與蒸餾技術,形成多層次的資源配置策略。企業在評估採用時,應同時考量長期維護成本、生態支援與安全治理機制,以確保在提升效率與控制風險間取得最佳平衡。

內容概述與背景連結¶

- 原文連結:https://www.techradar.com/pro/rewriting-the-blueprint-not-removing-bricks-multiverse-computing-says-it-can-shrink-large-ai-models-and-cut-memory-use-in-half(TechRadar報導的核心內容)。

- 相關參考連結:建議關注同行評測、壓縮技術的最新論文與案例研究、雲端部署實作指南,以及對中長期AI基礎設施成本結構的分析文章。

如需,我可以再補充更詳盡的背景資料、對比分析或以不同風格撰寫成文章版本。

*圖片來源:enclosure*