TLDR¶

• 核心重點:256GB SOCAMM2 LPDDR5x 記憶模組,最高配置可達2TB,具備低功耗與高頻寬特性。

• 主要內容:透過64顆32GB LPDDR5x晶片實現大容量與更高效能,適用於AI伺服器。

• 關鍵觀點:面對AI工作負載,顯著提升資料吞吐與能源效率,但對於單機配置的需求仍受限於伺服器規模。

• 注意事項:高容量模組對系統相容性與電源設計有較高要求,需搭配支援的平台與記憶體控制器。

• 建議行動:亟需規劃大規模AI部署的資料中心可用性與冷卻設計,並與伺服器平台廠商確認相容性。

文章內容

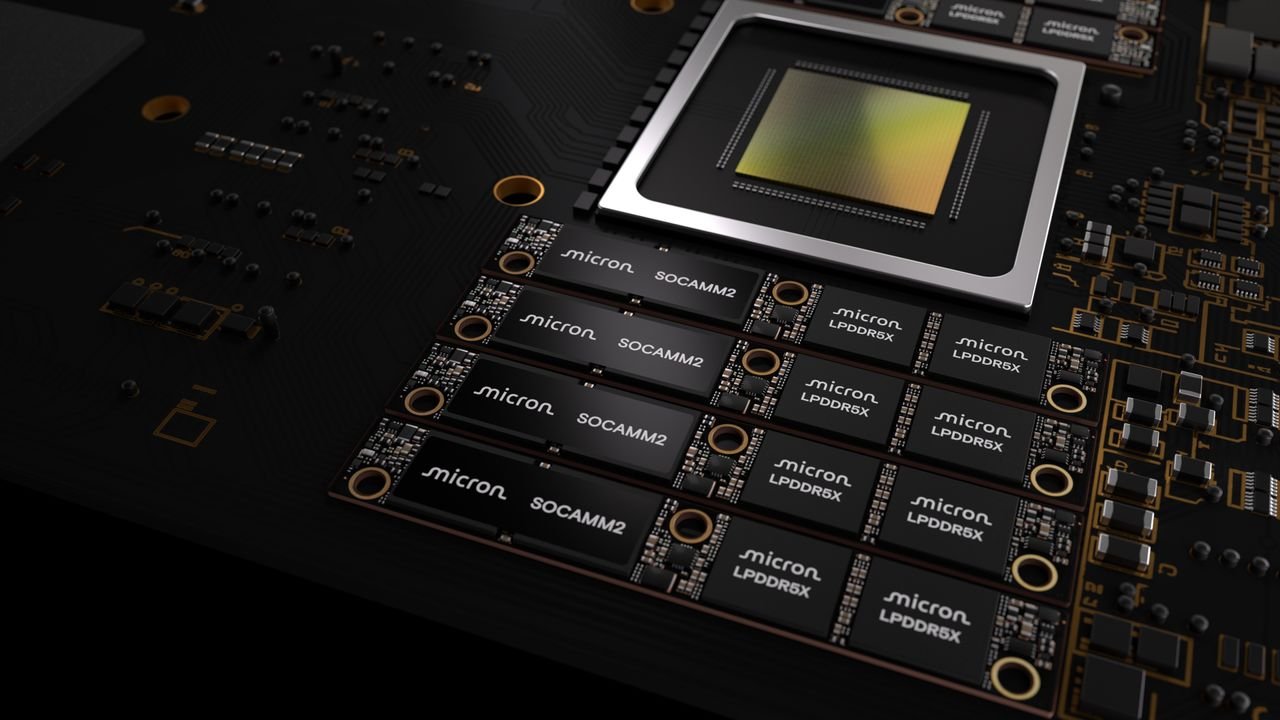

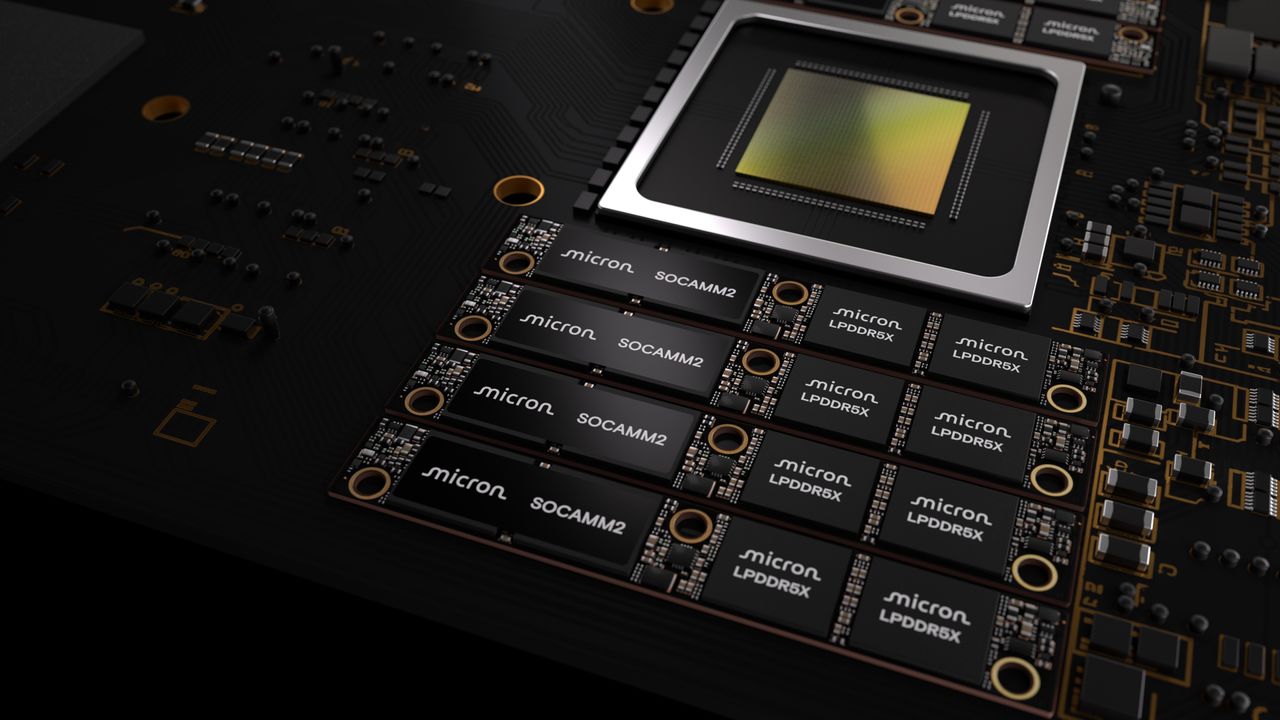

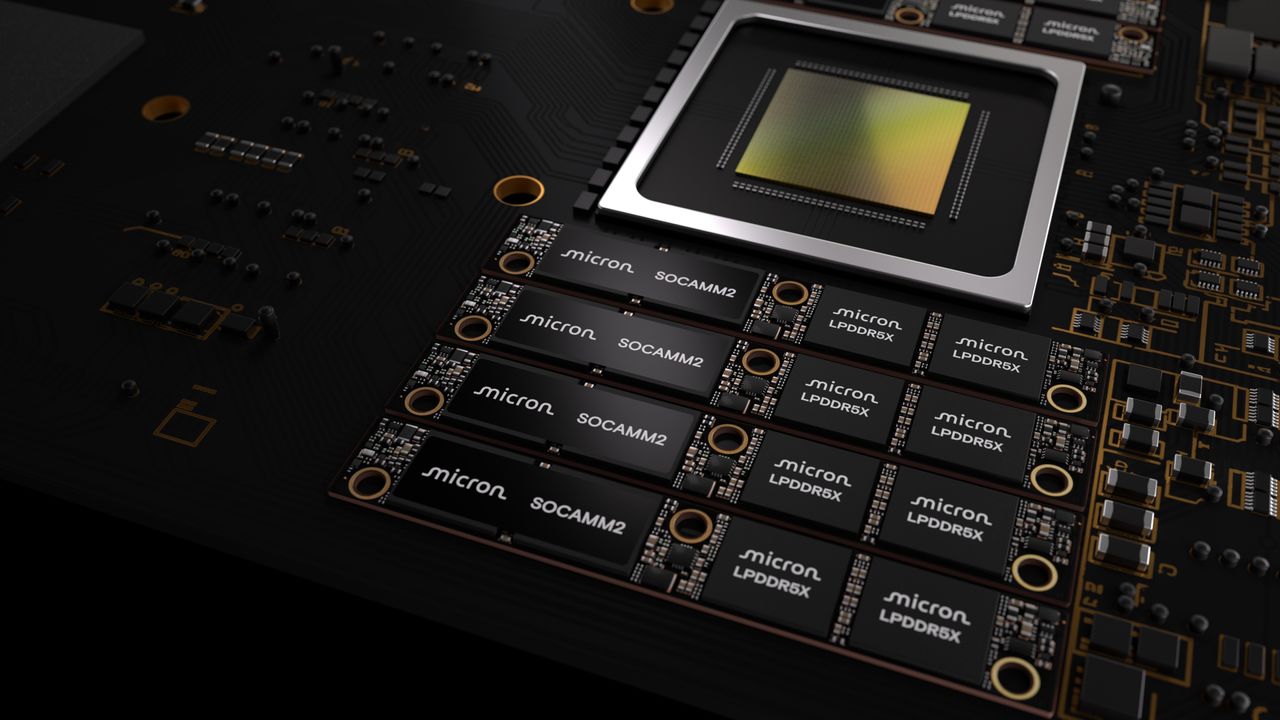

微型科技公司微紋科技(Micron)日前宣布推出一款256GB SOCAMM2 記憶模組,採用LPDDR5x技術,並以64顆32GB的晶片組成,這一設計旨在提升AI伺服器於大規模機器學習與推論工作負載下的記憶容量與頻寬。該模組的核心在於在相對有限的機電面積內,以高密度晶片組合實現更大的容量,同時透過先進的低功耗特性,降低整體能源消耗,對於需要長時間運算與高吞吐量的人工智慧工作負載具備實務價值。

在當前AI伺服器市場中,記憶體需求正快速攀升。雲端運算巨擘與大型資料中心在推理與訓練任務上,往往需要巨量的記憶體以避免頻繁的資料換出換入,進而提升整體效能與效能對功耗的比值(performance-per-watt)。LPDDR5x作為低功耗伺服器記憶體技術,提供更高的頻寬與更低的能耗,與SOCAMM2這樣的大容量模組結合,對於需要高並行度與大量並行執行緒的AI工作負載尤為有利。

重要的是,此次發布的產品定位於支援高端AI伺服器與資料中心環境,能以「8個模組組成的單一伺服器配置」在理論上達到約2TB的記憶容量。這意味著在多模組伺服器設計中,使用者可以在同一節點內部署更多的記憶資源,減少跨節點存取所產生的延遲與資料傳輸成本,進而提升訓練或推論任務的效率。不過,實際能否達到2TB容量,仍須視伺服器平台對8模組佈局的支援程度、主機板的記憶體插槽設計、記憶體控制器的管理能力,以及電源與散熱系統是否足以穩定運作。

背景與技術要點

1) SOCAMM2 的定位與技術特性

SOCAMM2 屬於微紋科技面向高效能資料中心與AI工作負載的記憶模組系列。以LPDDR5x為核心,與傳統伺服器記憶體相比,LPDDR5x在頻寬與延遲方面有顯著改善,同時透過低電壓與先進的整合設計降低功耗。256GB的容量組合,若以64顆32GB晶片構成,展現出相當高的晶片密度與佈線效率,適合需要大量本地快取與中階緩存的AI工作負載。

2) 為何是「256GB」與「2TB」的關係

在伺服器級設計中,單顆記憶體模組的容量配置對於整體系統容量的影響極大。若一個伺服器節點能裝入8個256GB的模組,理論上總容量可達到2TB。這種高密度模組對降低伺服器內部的板卡數量、減少機架空間佔用以及降低資料跨模組傳輸成本具有實際效益,同時也對記憶體控制器與主機板的設計提出更高的整合需求。

3) 能耗與散熱的考量

高容量與高頻寬的記憶模組往往伴隨較高的功耗與熱量。LPDDR5x等先進技術在降低單位資料傳輸的能耗方面有顯著進步,但在大容量佈局下,整機的散熱與電源管理仍是決定穩定運作與否的重要因素。雲端與資料中心的設計者需要評估冷卻解決方案、機櫃內部的風道佈局,以及電源供應的穩定性,才能確保在高負載狀態下模組不發生降頻或穩定性問題。

4) 與雲端巨擘的關聯性

報導指出,這類高密度模組的用途,在現今的AI伺服器市場中,雲端巨擘的部署策略往往扮演先行者角色。透過在伺服器中部署更高容量的記憶體模組,雲端服務提供者能在同一資料中心內實現更高的機架密度與更穩健的資料緩存策略,進而提升模型訓練與推論的整體效率。當然,一切的部署都需要管理平台與作業系統層面的支援,以確保記憶體的正確辨識與高效使用。

適用場景與影響

- AI模型訓練與推論:對於具備龐大參數量與高並行需求的深度學習模型,256GB 記憶模組提供更高的局部緩存與快取命中率,減少資料存取延遲。

- 資料密集型工作負載:如大規模圖形處理、科學計算、資料分析等需要大量快速記憶體的任務。

- 大規模伺服器叢集:在單機具備8個256GB模組的前提下,可實現2TB級別的總容量,利於資料分區與並行計算策略。

與此同時,使用者在採購與佈署時需留意以下幾點:

– 平台相容性:確認伺服器主機板與CPU/記憶體控制器支援8模組佈局與256GB模組的兼容性,並確認BIOS與韌體版本對LPDDR5x的特性支援程度。

– 電源與冷卻設計:高容量模組對電源電流與散熱有較高需求,需搭配穩定的電源供應與有效的機櫃冷卻方案。

– 系統管理與軟體支援:作業系統與虛擬化平台需能正確辨識與高效分配這些大容量記憶體,避免出現資源分配失誤或效能瓶頸。

– 成本與性價比:高密度模組在單位容量成本上可能高於傳統模組,企業在擴充時需評估長期運營成本與能耗。

市場前景與展望

隨著AI工作負載日益普遍,伺服器裝置的記憶體需求也在快速攀升。256GB SOCAMM2 記憶模組的推出,凸顯了記憶體技術在高效能運算領域的重要性。長期而言,若此類高容量模組能廣泛被伺服器平台原生支援,資料中心的機架密度與能源使用效率可望得到雙重提升。另一方面,實際的部署還需考慮到雲端服務供應商的架構標準與安全性要求,以及各家晶片製造商在生產良率與成本控制方面的競爭。

結論

*圖片來源:media_content*

Micron 的256GB SOCAMM2 記憶模組代表了在AI伺服器領域中,透過高密度與低功耗設計,實現更高容量與更佳能源效率的努力。雖然8模組佈局在單一伺服器中可達2TB容量的說法聽起來具體而振奮人心,但真實的部署成效將取決於伺服器平台的整體支援狀況、電源與散熱設計,以及資料中心的管理與維護能力。若市場與技術能協同配合,這類高容量模組在未來的AI訓練與推論任務中,將有望成為提升效能與降低能源成本的可行路徑。

內容概述¶

本篇報導聚焦於Micron推出256GB SOCAMM2 LPDDR5x 記憶模組的消息,該模組以64顆32GB晶片組成,設計初衷在於提高AI伺服器的記憶體容量與效能,同時藉由低功耗特性提升能源利用效率。文章說明此模組在理論上可與8個模組佈局搭配,達到約2TB的總容量,並探討這一技術對雲端巨擘以及大型資料中心的影響、系統整合的挑戰,以及實際部署時需考量的相容性、散熱與能源管理等因素。透過背景分析,本文亦闡述了高密度記憶模組在AI工作負載中的應用場景與未來發展方向。

深度分析¶

高容量記憶體在AI伺服器架構中的重要性,源自於對巨量模型參數與中間特徵資料的高頻存取需求。傳統伺服器記憶體往往在容量與頻寬之間需要做取捨,而LPDDR5x作為互連與記憶體介面的改進,提供更高的資料傳輸速率與更低的能源消耗,對於需要大規模並行運算的深度學習工作負載尤為關鍵。本次Micron推出的256GB SOCAMM2模組,採用64顆32GB晶片的組合,這樣的密度設計意味著在單模組層面就能提供相當高的容量,適配對記憶體容量要求嚴格的運算任務。

若以單伺服器8個此類模組的配置來看,理論上可達到2TB的總記憶體容量。這在雲端資料中心的實務部署中,意味著可在較少的伺服器節點中提供更高的機架密度,從而提升整體運算能力與資源利用效率。當然,實際實現需要硬體與軟體兩端的協同配合,包括主機板對8模組佈局的支援、記憶體控制器的容量與介面效率、BIOS/韌體的相容性,以及作業系統的資源分配策略。

此外,高容量模組的引入也帶來了電源與散熱方面的挑戰。高頻寬與高密度資料傳輸意味著模組在長時間高負載下的功耗可能增加。資料中心要維持穩定的性能,需強化電源設計與機櫃冷卻能力,例如增設風道優化、提升散熱片面積、採用更高效的風扇與液冷解決方案等,以避免熱耗引發的熱檔測與熱降頻現象。

在市場層面,雲端巨擘往往具備更大的裝置與資金規模,能夠承擔高容量模組的成本並在全局部署成本與效益間找到平衡。這些企業在大量資料與模型訓練任務中,透過提升本地緩存容量與降低跨節點資料傳輸需求,能顯著縮短訓練週期,提升推理效率,進而提升整體服務性能與商業價值。然而,對於中小企業與邊緣計算場景,高容量模組仍需考量成本與架構的穩定性。

在未來展望方面,若LPDDR5x與高密度模組能與伺服器平台緊密整合,並且各大晶片商提供更標準化的相容性與管理工具,這類技術有望成為新一代資料中心的常態配置之一。伺服器廠商也可能針對高容量記憶模組推出專屬的熱管理與能效優化解決方案,以確保在不同型號與工作負載下的穩定表現。

觀點與影響

- 對AI研發與商業部署的影響:更高容量的本地記憶體能降低資料搬移成本與緩存未命中的情況,進而提升訓練與推論的整體效率,特別是在處理巨型模型或大量資料集時。

- 對資料中心設計的啟示:需要重新思考機櫃與佈局設計,以支援高密度模組的散熱與電源需求,並且強化軟體層面的資源管理與監控。

- 對供應鏈與成本結構的影響:高容量模組的生產成本與良率控制是關鍵,若能規模化生產,成本下降將有助於更廣泛的商業採用。

- 安全性與可靠性考量:更高的模組密度意味著更多的故障點,需進一步完善記憶體壽命管理、錯誤更正機制與韌體更新策略。

重點整理

關鍵要點:

– Micron 推出256GB SOCAMM2 LPDDR5x 記憶模組,採64顆32GB晶片組成。

– 最終用途可與8模組佈局結合,理論上達到2TB系統容量。

– 採用LPDDR5x技術,著重高頻寬與低功耗特性。

需要關注:

– 平台相容性與8模組支援狀況。

– 電源與散熱方案的設計與實施。

– 軟體層面的資源管理與作業系統相容性。

總結與建議

此次發布的256GB SOCAMM2 記憶模組顯示出在AI伺服器領域對高容量、高頻寬與低功耗的結合有明確的市場需求。對於雲端巨擘與大型資料中心而言,若伺服器平台能穩定支援8模組佈局並有效管理熱與功耗,2TB 的理論容量將為大型模型訓練與大規模推論提供更具彈性與成本效益的方案。企業在考量採用此類高密度模組時,需重點評估平台相容性、冷卻與電源設計,以及軟體資源分配的支援程度。長遠而言,若相關生態與標準能更成熟,這類高容量LPDDR5x模組有望成為資料中心與雲端服務的新常態配置,推動AI工作負載的效能與能源效率雙重提升。

相關連結¶

- 原文連結:https://www.techradar.com/pro/micron-launched-a-256gb-socamm2-memory-module-using-64-32gb-lpddr5x-chips-and-yes-hyperscalers-can-shove-8-in-an-ai-server-to-reach-2tb-capacity-mere-mortals-need-not-apply

- 相關參考連結:

- Micron 官方產品簡介與技術規格說明

- LPDDR5x 記憶體技術白皮書與效能報告

- 資料中心散熱與電源設計最佳實務指南

*圖片來源:enclosure*