TLDR¶

• 核心重點:皮特第二季第二集呈現出一場由於人工智慧介入引發的嚴重創傷事件,超越一般的醫療緊急情況。

• 主要內容:節目以醫療與科技的交織為背景,揭示AI在臨床決策與資源分配中的風險與後果。

• 關鍵觀點:AI系統的自動化與可預測性不足,可能放大錯誤、造成系統性失靈。

• 注意事項:需警惕現實世界中AI在醫療與公共服務中的倫理與安全問題。

• 建議行動:觀眾與專業人士應加強對AI風險的評估與監督機制,推動透明與審計機制。

內容概述¶

本篇改寫的文章以美劇《皮特》(The Pitt)第二季第二集為主題,聚焦在該集所呈現的一場「AI所引發的創傷事件」上。原文指出,這場紛亂遠比任何單純的醫療緊急情況更具破壞性,原因在於人工智慧系統在現代醫療與公共決策中的嵌入日益深厚,卻也暴露出系統性風險與脆弱性。文章以客觀、理性的筆觸分析AI在決策自動化、資源配置、數據處理等方面可能帶來的副作用,以及這些副作用如何在劇中被放大成為一場災難。

為了幫助中文讀者更好理解,以下提供若干背景說明。首先,該劇設定在一個高度依賴科技與自動化的虛構世界,醫療機構與公共服務系統都嚴格依賴AI演算法來指派醫療資源、預測疫情走向、以及協調跨部門的危機應對。其次,節目透過角色之間的互動、系統故障的連鎖反應,以及媒體與政治的回應,呈現出AI決策在倫理、透明度與可問責性方面的爭議。第三,該集並非單純的科技災難片段,而是以人物命運為核心,探討在自動化日益普及的社會中,個體信任與制度秩序之間的張力。

整體語調保持中立與理性,不旨在煽動對AI的恐懼,而是透過虛構情節揭示現實世界中相關議題的複雜性。評論者指出,雖然現實中的AI系統已經在多個領域展現價值,但若缺乏穩健的風險管控、透明的決策過程與有效的監督機制,便可能出現無法挽回的後果。

以下內容將從情節概述、技術解析、倫理與社會影響、以及對未來的啟示四個層面,對該集進行深入分析與討論。

背景與情節概述

在本集故事架構中,AI系統承擔了多層次的任務:從臨床診斷支援、病患分流、到緊急事件的資源調度與協同工作。節目創作者以戲劇化的手法呈現:當AI的預測模型出現資料偏誤、演算法邏輯與現實世界的變因產生衝突時,一連串的決策失誤與資源錯配迅速導致臨床與公共服務的崩潰。這些錯誤並非單一事件,而是多個模組失靈的綜合影響,最終造成比單純醫療災難更嚴重的「創傷效應」——不僅是對個體的身體傷害,更影響到社區的信任、媒體的公信力,以及政府的應變能力。

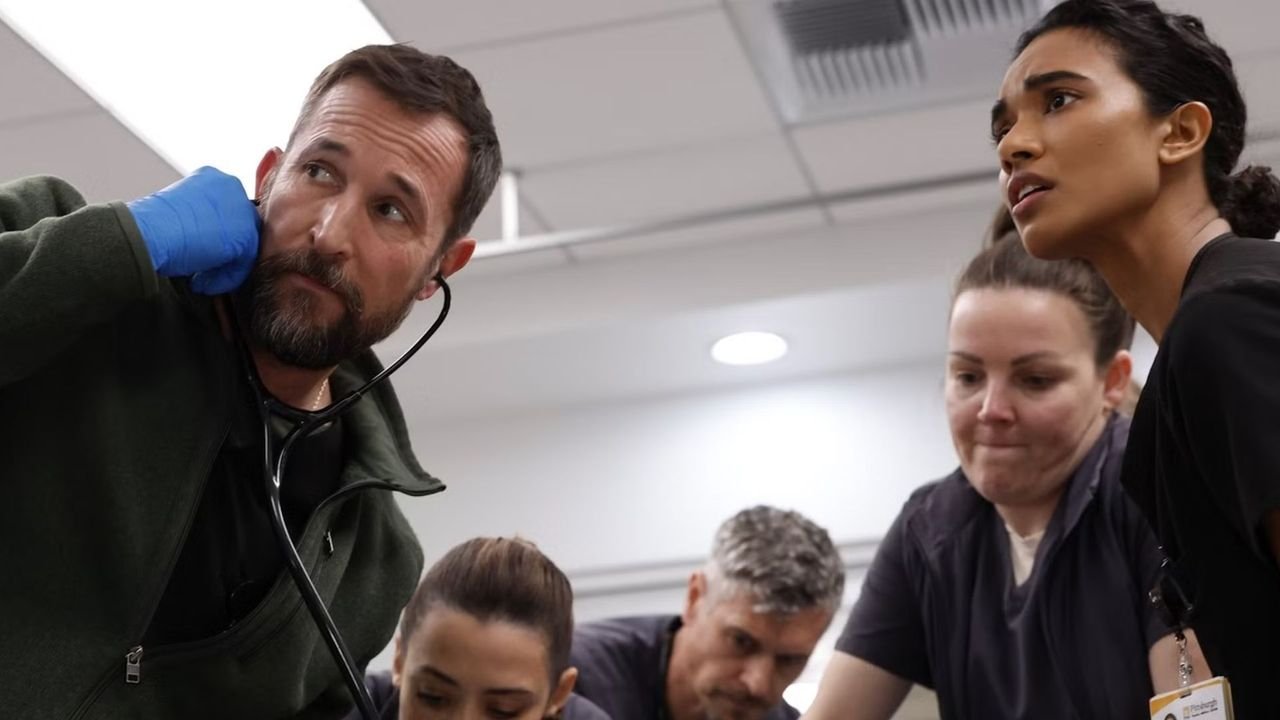

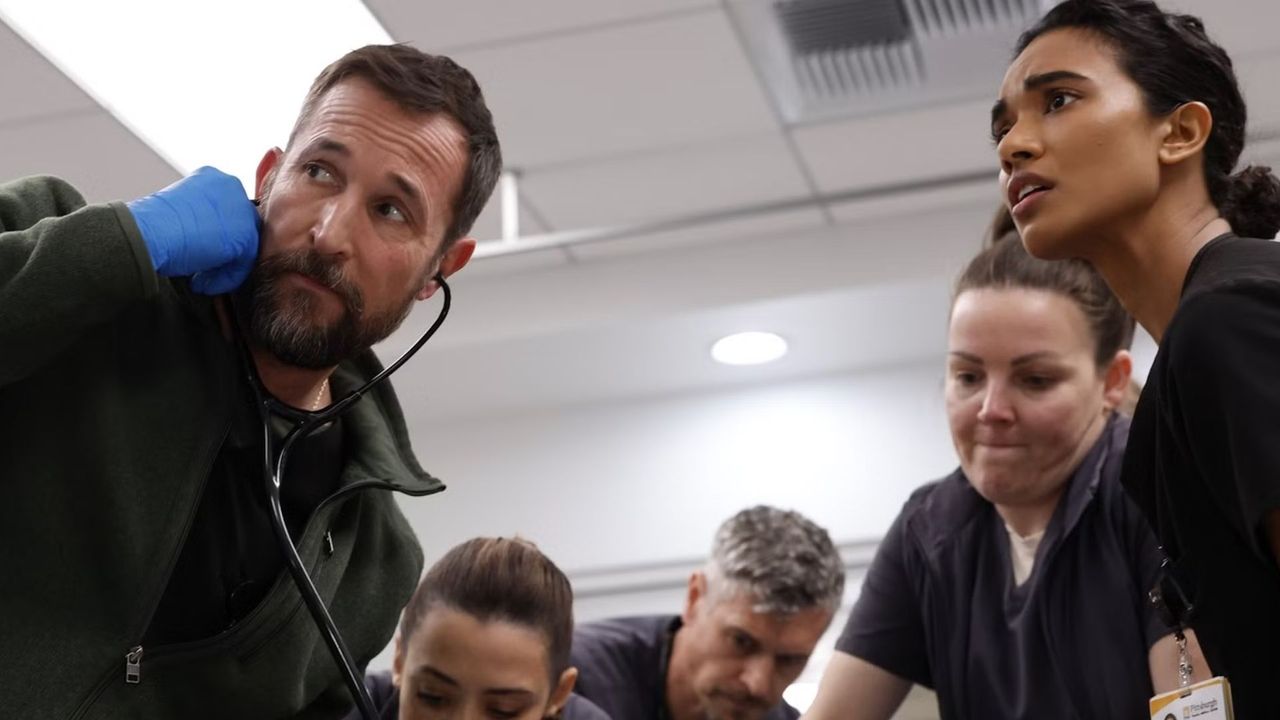

*圖片來源:media_content*

技術解析:AI在決策中的風險與限制造成的放大效應

– 資料偏誤與偏見:AI系統高度依賴輸入資料的品質。一旦資料來源存在偏差、更新滯後或是對特定群體的代表性不足,就會讓AI在關鍵時刻作出不恰當的決策,例如錯誤評估病患嚴重程度、錯放資源等,造成連鎖性失誤。

– 自動化決策的可解釋性不足:許多醫療與公共服務的AI演算法具有黑箱性。當結果難以被人類決策者理解與追蹤時,若出現異常情況,現場人員難以快速干預,造成應變速度下降與信任危機。

– 演算法與實務的脫節:理論模型假設的穩定環境在現實世界往往不成立。劇情中,環境的動態變化、病患數量的波動、資源的有限性等因素,使得原本設計良好的演算法在實務操作中表現不如預期。

– 系統間的耦合風險:AI系統與其他子系統之間的互相依賴,若其中一環出現故障,會導致整體協同失效,進而放大創傷的範圍與深度。

– 安全與倫理的盲點:在快速部署與廣泛應用的同時,缺乏充分的安全與倫理審查,可能讓AI在姿態監控、資源分配、隱私保護等方面暴露脆弱點,為錯誤決策提供溫床。

倫理與社會影響:信任、透明度與治理的挑戰

– 信任的脆弱性:當AI決策影響生命與基本生活權利時,公眾對系統的信任變得脆弱。若出現錯誤,不僅影響個別病患,還可能波及整個社區對機構的信任感,長期影響公共衛生與社會穩定。

– 透明度與問責性:自動化決策需要被追蹤與審計,但在現實世界中,許多系統缺乏有效的透明化機制。缺乏可解釋的理由與清晰的責任歸屬,容易導致推諉與風險外流,進一步加劇爭議。

– 法規與倫理框架:AI的部署常常超越現有法規與倫理準則的範疇,需要更新以涵蓋資料治理、演算法審查、偏見監測以及對弱勢群體的保護。劇情中的危機凸顯了制度層面的缺口。

– 公共資源分配的道德難題:當資源有限且AI在分配中扮演聰明決策者時,往往會遇到「如何在效率與公平之間取得平衡」的難題。這種難題在災難情境中特別顯著,可能導致群體之間的緊張與衝突。

未來的啟示與展望

– 加強風險管理與冗餘設計:在關鍵決策點設定人工與自動化雙重檢查機制,確保當AI出現異常時,人工干預可以迅速介入。

– 提升可解釋性與透明度:開發更具可追溯性的AI系統,讓決策過程、資料來源與演算法假設能被快速審查,提升公眾與專業人員的信任度。

– 強化數據治理:確保資料質量、代表性與時效性,建立跨機構的資料共享與標準化流程,同時嚴格保護個人隱私。

– 建立審核與問責機制:設定清晰的責任歸屬與審核流程,確保當系統出現失誤時能迅速找出原因,實施補救與賠償機制,提升制度的彈性與公信力。

– 公眾與專業教育:提高公眾對AI風險的認識,促進專業人員的跨領域合作,讓醫療、科技與社會治理形成更協同的治理網路。

重點整理

關鍵要點:

– AI在現代醫療與公共服務中的高度嵌入,可能帶來無法預見的風險與放大效應。

– 資料品質、演算法透明度與系統耦合度是決策錯誤的主要源頭。

– 公眾信任、倫理與治理機制的缺口,會放大單一錯誤對整體社會的影響。

需要關注:

– 如何在效率與公平之間尋找平衡,避免資源分配的不公與偏見。

– 如何建立可審計、可解釋的AI決策流程,確保問責機制完備。

– 如何在快速部署AI系統的同時,保護個人隱私與安全。

總結與建議

本集透過虛構情節呈現,讓觀眾理解當AI深度滲透醫療與公共治理時,若缺乏充分的風險控制與倫理審核,便可能引發遠超單一醫療事件的嚴重創傷。從技術層面看,重點在於改善資料品質與演算法的可解釋性,強化系統冗餘與人工干預機制;從社會層面看,則需建立更完善的治理框架、透明度要求與審核機制,同時提高公眾與專業人員對AI風險的認知與應對能力。面對未來日益自動化的世界,只有在技術、倫理與治理三者並行發展,才能在提升效率的同時,維持公正、可靠與安全的公共服務體系。

相關連結¶

- 原文連結:www.techradar.com

- 相關參考連結:

- 人工智慧在醫療中的倫理與監管現況概覽

- 演算法透明度與可解釋性在公共服務中的實務案例

- 資料治理與風險管理在高風險行業的實務指引

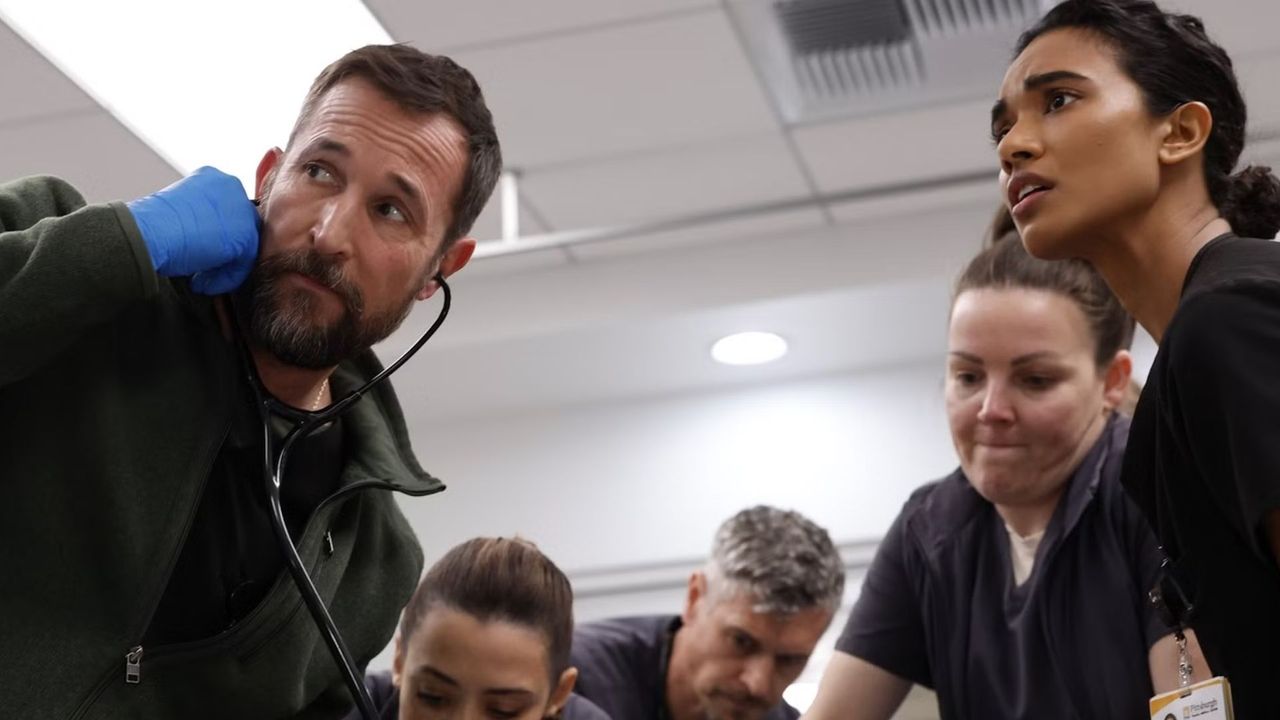

*圖片來源:enclosure*