TLDR¶

• 核心重點:Linux 為資料平台奠定穩定、高效的基礎,廣泛被雲端服務、資料庫、訊息系統等工具原生支援。

• 主要內容:介紹 Linux 對資料工程的重要性、常見作業環境與工具、以及 Vi 與 Nano 的實務使用範例。

• 關鍵觀點:掌握命令列與自動化,能提升資料管道的穩定性與可扩展性。

• 注意事項:需理解不同發行版與檔案系統的差異,以避免相容性問題。

• 建議行動:實作基本指令與腳本,逐步建立可重用的資料處理工作流程。

內容概述¶

本篇文章旨在以中階到高階資料工程師為對象,闡述 Linux 作為資料平台核心的角色與優勢,並透過實際範例說明如何在日常工作中運用 Vi 與 Nano 等編輯工具。Linux 的穩定性、效能及廣泛的工具生態,使得設計與執行資料管道、資料庫管理、以及雲端服務整合等任務時更加高效。由於現代資料工件往往需要分散式處理、批次與實時資料流,以及強化的自動化能力,熟悉 Linux 的指令列介面與自動化工作流程,成為資料工程師的重要技能之一。

在本篇文章中,讀者將看到以下重點:為何 Linux 成為資料工程的基石、在日常工作中常見的作業環境與工具選擇、以及命令列下的實務技巧。為了便於中文讀者理解,本文亦會對關鍵概念進行背景說明,協助從業人員在不同發行版與部署情境中做出適切的選擇。

以下內容在不失客觀中立的前提下,力求清楚、完整地呈現 Linux 在資料工程領域的實務價值,並提供可操作的學習路徑與建議。

深度分析¶

Linux 對資料工程的重要性與定位

Linux 為多數現代資料平台提供穩定、可預期的運行環境。絕大多數雲端服務、關聯式與非關聯式資料庫、以及像是 Kafka 之類的訊息系統,均原生設計於 Linux 環境上運作。其核心優勢包括穩定性、效能、可自動化的腳本工具,以及豐富的系統層級資源控制能力,這些特性使得資料管道的建置、佈署與監控變得可預期且易於擴展。常見工作場景與工具選型

資料工程師在日常工作中,常需處理伺服器部署、日誌分析、資料移轉與流量管理等任務。Linux 上的工具鏈如 Shell 指令、 Awk、 Sed、 Tar、 rsync、 crontab、 systemd 等,能有效支援排程任務、檔案處理與服務管理。雲端環境中的容器技術(如 Docker、Kubernetes)往往與 Linux 緊密結合,熟悉容器化與部署流程能提升整體工作效率與可靠性。編輯器的實務使用:Vi 與 Nano

Vi 和 Nano 是 Linux 環境中廣泛使用的文字編輯器,雖然風格與功能不同,但各有適用場景。Vi(及其變體 Vim)提供高效的鍵盤操作、模組化設定與高度客製化,適合需要長期編輯、撰寫腳本或快速在伺服器上修改配置的情境。Nano 則以易上手著稱,介面直覺、以按鍵為主的操作更適合初學者或需要快速編輯短文檔時使用。實務上,學會在兩者之間自由切換,能讓你在不同伺服器與情境中都能順利完成編輯任務。實作與自動化的核心能力

資料工程的核心在於可重現的流程與自動化。掌握 Shell 腳本、簡單的 Python/Go 程式,以及與資料處理框架的整合,能把資料提取、轉換、載入(ETL/ELT)等流程自動化,並以日誌與監控機制確保穩健執行。對於大量資料與高頻更新的場景,理解檔案系統與 I/O 行為、快取策略、以及資源限制的影響尤為重要。安全與合規的考量

在多租戶與雲端部署情境下,適當的權限控管、使用 SSH 金鑰、關閉不必要的服務、以及日誌審計都屬於基本要求。Linux 的使用者與群組、檔案權限、SELinux 或 AppArmor 等安全模組,能協助維持系統的安全與穩定性。對於資料存取與管道工作流,建立最小權限原則與審計追蹤能降低風險。常見挑戰與解決策略

Linux 學習曲線對新手可能較陡,但透過實作練習、建立個人筆記與自動化樣板,可以快速提昇。遇到相容性問題時,瞭解各 Linux 發行版的差異(如套件管理器、預設路徑、系統服務管理工具等)是關鍵。對於高可用與大規模部署,採用容器化與自動化部署工具(例如 CI/CD 流程)能降低人為錯誤並提升可擴展性。實務範例導引

1) 快速建立日誌轉存工作:在 Linux 伺服器上設定日誌輪替與自動移轉,配合 rsync 將日誌檔案每日自動同步到資料倉庫或雲端儲存。

2) 設定排程任務與監控:使用 crontab 設定每日批次任務,並建立簡單的監控腳本以檢查任務返回碼與關鍵日誌,若失敗即可通知相關人員。

3) 版本控制與設定自動化:將伺服器設定、資料流程腳本與工具配置版控(Git),並透過自動化流程在部署環境中一致生效。

4) 資料管道的容器化與編排:在需要時以 Docker/Kubernetes 方式部署資料處理任務,確保環境一致性與水平擴展能力。

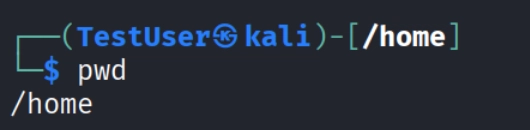

5) 文字編輯與設定檔管理:日常在伺服器上編輯配置檔與腳本,透過 Vi/Vim 與 Nano 的熟悉度提升編輯效率。

*圖片來源:description_html*

- 學習與實踐路徑建議

- 初學階段:熟悉基本指令(檔案與目錄操作、搜尋、過濾與排序、管道與重定向)。

- 進階階段:學習正規表示式、日誌分析技巧、基本腳本撰寫與排程任務。

- 專家階段:含容器化部署、雲端整合、資料管道自動化與監控、資安與合規實務。

- 日常習慣:建立個人筆記與範本庫,常用腳本與設定檔實作成模板,以提升重複任務的效率。

觀點與影響¶

Linux 作為資料工程的核心平台,其穩定性與靈活性直接影響到資料管道的可靠性與可維護性。能夠熟練使用命令列與自動化工具,能有效降低手動操作錯誤,提升整體工作效率與協作效能。隨著雲端化與容器化的普及,越來越多的資料處理流程被拆解為微服務或獨立工作單元,Linux 的角色因此更加重要。不僅在單機伺服器上執行,也在分散式環境中扮演關鍵角色,例如容器內的資料處理任務、微服務間的日誌與事件傳遞、以及在 Kubernetes 叢集中的部署與監控。未來,對資安與資料治理的要求將日益提高,熟悉 Linux 的使用者與系統管理能力,亦包含對審計、權限控管與日誌管理的深度理解,將成為區分專業與新手的重要差異。

此外,Vi 與 Nano 的實務運用能力,代表著對工具生態的掌握與適應性。能在不同伺服器與情境中快速切換,並用最合適的方式完成文字編輯與設定檔修改,能降低學習成本與工作阻力。綜觀而言,具備扎實的 Linux 基礎與實務經驗,將使資料工程師在高需求的數據環境中更具競爭力,也能更自信地領導或參與跨團隊的資料解決方案。

重點整理¶

關鍵要點:

– Linux 為資料工程的穩定與高效基礎,廣泛支援雲端、資料庫與訊息系統。

– 常見工作場景需掌握系統管理、自動化腳本與日誌處理等能力。

– Vi 與 Nano 各有優勢,熟悉兩者可提升在不同伺服器的編輯效率。

需要關注:

– 不同 Linux 發行版的差異可能影響套件與路徑配置,需留意相容性。

– 安全與審計在分散式與多租戶環境中的重要性日增。

– 大型資料管道需結合容器化與自動化,以確保可重現性與可擴展性。

總結與建議¶

本文章以實務角度說明 Linux 在資料工程中的核心角色,並透過 Vi 與 Nano 的實用範例,幫助讀者建立實作與自動化的能力。建議新手以逐步練習的方式,從基本指令與檔案管理開始,逐步加入排程任務與簡單自動化腳本;對於有一定基礎的從業人員,進一步掌握工具生態、容器化與雲端整合,將有助於提升資料管道的穩定性與可擴展性。最終,通過建立版控與自動化部署流程,能讓整個資料工程工作流更具可重現性與長期可維護性。

相關連結¶

- 原文連結:https://dev.to/geraldm/introduction-to-linux-for-data-engineers-including-practical-use-of-vi-and-nano-with-examples-1ian

- 相關參考連結(待補充):

- Linux 基礎與指令手冊概覽

- Vi/Vim 使用指南與高階技巧

- 資料管道自動化與容器化基礎

禁止事項:

– 不包含思考過程或「Thinking…」標籤

– 文章必須直接以 “## TLDR” 開始

請確保內容原創且專業。

*圖片來源:description_html*